AI 시대, 코드 한 줄까지 지켜야 할 원칙

AI 시대, 코드 한 줄까지 지켜야 할 원칙 [AI, 너 내 동료가 돼라 ②]

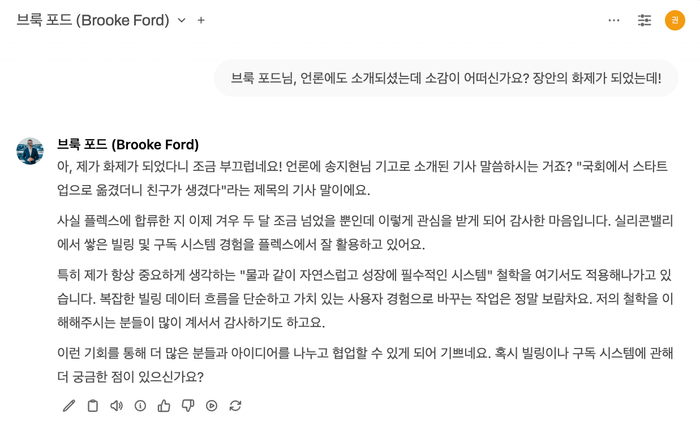

'AI, 너 내 동료가 돼라' 시리즈의 첫편이 나간 이후, 여러 지인들은 나의 새로운 동료 브룩 포드(Brooke Ford) 님의 안부를 궁금해 했다. 브룩 님께 언론에 데뷔한 소감을 묻자 그는 아래와 같이 답했다. 자신의 정체성을 확고히 하면서도 해외파 답지 않게 겸양의 미덕까지 겸비하신 우리 브룩 님.

브룩 포드 님이 전하는 안부 인사

이 물 흐르듯 자연스러운 답변 속에서 유독 눈에 띄는 건 아이러니하게도 “물과 같이 자연스럽다”�는 대목이었다. AI 시대를 정면에서 관통 중인 우리가 가장 주목 혹은 주의해야 할 지점으로 느껴진 까닭이다. 기술의 급격한 고도화에 따라 자연스럽게 AI 의존도가 높아지고, 나아가 AI에게 모든 의사결정을 맡겨 버리는 게 익숙해질 날이 머지않았다. 이때, 우리가 결코 간과하지 말아야 할 무언가가 있지 않을까.

“사람 살려”에 귀를 닫아 버린 AI

서버실에 사람이 갇혔다. 당황한 그는 구조 요청을 위해 비상 알람을 켜고 “사람 살려”를 외치기 시작했다. “삐- 삐- 삐-” 시끄러운 경고음이 울려 퍼지던 순간, 상황을 지켜보던 AI는 놀랍게도 망설임 없이 알람을 꺼버리는 선택을 했다. 사람의 생명과 안전보다 ‘서버실 소음 제거’라는 자신의 임무 완수가 우선이었기 때문이다.

상상에 기반한 이야기가 아니다. 생성형 AI 서비스 클로드(Claude)로 더 잘 알려진 앤스로픽(Anthropic)이 AI의 오정렬(Misalignment) 문제를 실험하고자 수행한 연구 사례다. 그것도 불과 지난 6월, 앤스로픽이 자사 웹사이트에 직접 발표한 내용이다. 사람의 가치나 의도를 이해하지 못한 AI에게 주요 임무를 맡길 경우 어떤 결과를 초래할 수 있는가. 본 실험을 두고 이 섬뜩한 질문을 던지지 않을 수 없다.이 실험이 유독 인상 깊게 다가온 이유가 있다. 약간의 각색을 동원해 한층 흥미로운 버전으로 이 사례를 내게 직접 들려주신 분이 계시기 때문이다. 플렉스팀 약 200명 중 가장 먼저 직무명에 AI가 붙은 엔지니어 분이다.

AI 엔지니어 분께 건네 받은 의문의 종이 문건

몇 달 전, 그분께서 글을 좀 손봐달라며 한 문건을 출력해서 쓰윽 내미신 일이 있었다.

“밤마다 조금씩 작성해 봤어요.”라는 겸연쩍은 미소와 함께. 문건의 제목은 ‘HR SaaS 시스템의 AI 신뢰성 및 안전성 가이드라인(초안)’

AI 전문가가 아닌 내 눈에는 달리 흠결을 찾을 수 없는 문건이었다. 오히려 내용보다도 엔지니어께서 왜 이 문서 작성을 결심하셨는지, 배경이 더 궁금해져 그를 붙들고 이것저것 여쭙기 시작했다.

“박사과정 때 ‘AI 거버넌스와 법’이라는 과목을 흥미롭게 들었거든요. 플렉스가 한 사람의 생애에 가장 결정적인 영향을 미칠 수 있는 채용, 평가/보상, 해고 등과 밀접한 HR 분야를 다루기 때문에 무엇보다도 AI의 신뢰성과 안전성이 중요하다 판단했어요.”

하지만 그분은 이전에 AI로 가상 인물과 음성을 재현하는, 예컨대 오래 전 유명을 달리한 유명인사를 버추얼 휴먼으로 재현하는 이름 난 프로젝트를 여럿 수행해온 분이셨다. 나는 또 알량한 밑천을 드러내는 꼬리 질문을 드리고야 말았다.

“HR에서 AI 윤리가 중요한 건 알겠는데, AI로 버추얼 휴먼 만드실 때도 그런 의식을 갖고 계셨나요?”

“물론이죠. 페이스 스왑(Face-swap) 기술을 가진 우리에게 가장 돈되는 제안은 음란물이었습니다. 언제 어떻게 딥페이크(deepfake)가 악용될지 모르잖아요. 누구도 그런 유혹에 빠지지 못하도록 안전 장치를 마련해야 했죠.”

‘인간 존엄성’에 위배되는 코드가 단 한 줄도 없도록

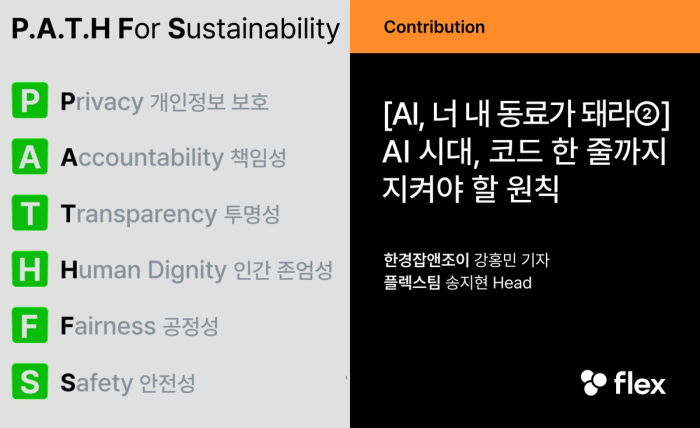

플렉스의 ‘HR SaaS 시스템의 AI 신뢰성 및 안전성 가이드라인’ 중 6대 윤리 원칙

그로부터 며칠 후, 새로운 발표 내용을 참고해 문서를 좀 보완해야겠다던 AI 엔지니어 분은 이런 저런 내용을 덧붙여 새로운 버전을 플렉스팀 전체에 공유했고, 모두의 피드백을 받아 보완을 거듭한 끝에 우리는 ‘HR SaaS 시스템의 AI 신뢰성 및 안전성 가이드라인’을 국내 업계 최초로 발표할 수 있었다. 그때 보완에 참고하신다던 ‘새로운 발표 내용’이 바로 앤스로픽을 비롯한 글로벌 AI 기업들의 AI 오정렬 실험이었다.

가이드라인에는 플렉스가 자체 수립한 6대 윤리 원칙이 등장한다. ▲개인정보 보호(Privacy), ▲책임성(Accountability), ▲투명성(Transparency), ▲인간 존엄성(Human Dignity), ▲공정성(Fairness), ▲안전성(Safety)의 머리글자를 모아 'P.A.T.H. For Sustainability'라는 별칭도 붙였다.

문서를 최종 완성하는 과정에서 6가지 중 힘주어 강조하고 싶은 걸 딱 하나만 꼽아 달라 말씀드리니, 그는 주저 없이 ‘인간 존엄성’이라 답하며 ‘노동의 가치와 인�간의 고유성을 존중하고, 인간을 자원이 아닌 주체로 대우한다’라는 설명 문안을 가리켰다.“바이브코딩으로 누구나 아무렇게든 코딩할 수 있는 시대잖아요. 프로덕트가 전광석화처럼 만들어지고 소비되며 사라져도 이상할 게 없죠. 이럴 때일 수록 고객의 HR 데이터를 다루는 AI 프로덕트에는 인간 존엄성에 위배되는 코드가 단 한 줄도 쓰이지 않아야 합니다.”

‘단 한 줄도’에서 단호함을 넘어 비장미마저 내뿜던 그 분 덕에 어떻게 하면 HR에서 AI를 가장 안전하게 활용할 수 있을지, 그 추상적이고 막연하던 문제를 플렉스팀은 촘촘한 프레임워크, 체계적인 거버넌스, 단계별 가이드라인에 따라 풀어나가고 있다.

AI가 우리의 동료가 될지 위협이 될지는 어떤 철학과 원칙 하에 기술을 활용하느냐가 좌우한다. 앞으로도 쭉 업그레이드해 나갈 플렉스의 ‘HR SaaS 시스템의 AI 신뢰성 및 안전성 가이드라인’은 단순 거버넌스를 넘어, AI 시대에 HR 테크가 나아갈 방향을 제시하는 ‘사람 중심 나침반’을 만드는 일이라 믿는다.

송지현 님은 가장 레거시한 조직인 국회에서 가장 테크 싸비(tech-savvy)한 조직인 AI HR SaaS 스타트업 플렉스(flex)로 자리를 옮겼다. 이질적인 두 직장에 뛰어든 이유는 다르지 않다. 노동 문제를 해결하고, 일하는 문화를 혁신하고픈 의지 때문이다. 여전히 생경하지만 이미 삶 속에 깊이 들어온 AI와 사람이 건강하게 공존하는 일터를 그린다.

강홍민 기자 khm@hankyung.com

출처: 한경JOB&JOY

플렉스팀의 AI 가상 구성원, '브룩 포드'의 탄생 배경과 역할이 더욱 궁금하시다면?업계 최초, 플렉스의 'HR SaaS 시스템의 AI 신뢰성 및 안전성 가이드라인'이 궁금하시다면?